Asia Pasifik (APAC) telah menjadi pionir dalam adopsi teknologi kecerdasan buatan (AI). Namun, perjalanan ini belum lepas dari tantangan. Salah satunya adalah biaya inferensi yang terus meningkat, mengancam kinerja dan skala aplikasi nyata. Untuk mengatasi hal ini, banyak perusahaan di APAC mulai merubah strategi infrastruktur AI mereka ke perbatasan (edge computing).

Perubahan Strategi: Dari Cloud ke Edge

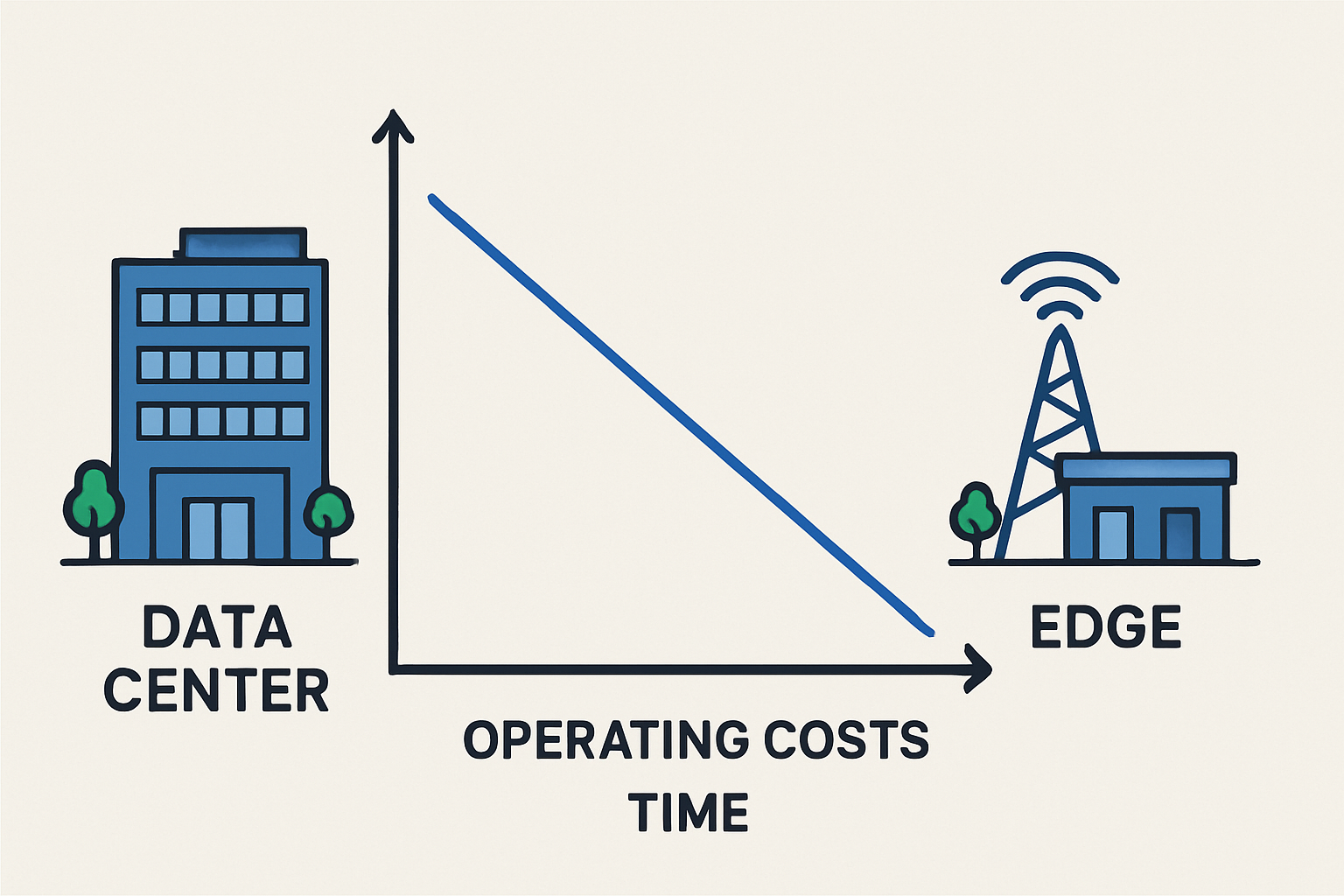

Tradisionalnya, perusahaan mengandalkan cloud untuk menjalankan inferensi AI. Namun, metode ini memiliki beberapa kelemahan. Pertama, biaya operasional cloud bisa sangat mahal, terutama untuk perusahaan yang beroperasi di wilayah yang jauh dari pusat data. Kedua, latensi menjadi masalah signifikan karena data harus diteruskan dari lokasi pengguna ke pusat data dan kembali. Ketiga, skala real-time yang dibutuhkan oleh aplikasi nyata seringkali sulit dicapai dengan metode cloud.

Akamai, salah satu pemimpin dalam layanan cloud, telah merespons tantangan ini dengan mengembangkan Inference Cloud. Proyek ini dikolaborasikan dengan NVIDIA dan didukung oleh GPU terbaru Blackwell. Ide di baliknya sederhana: jika kebanyakan aplikasi AI memerlukan keputusan yang diambil secara real-time, maka keputusan tersebut seharusnya diambil dekat pengguna, bukan di pusat data yang jauh.

Jay Jenkins, CTO dari Cloud Computing Akamai, menjelaskan kepada AI News mengapa momen ini memaksa perusahaan untuk merenungkan kembali cara mereka mengimplementasikan AI. Dia menekankan bahwa inferensi, bukan training, kini menjadi batasan utama.

Mengapa Proyek AI Sulit Tanpa Infrastruktur yang Tepat

Jenkins mengungkapkan bahwa selisih antara eksperimen dan penerapan skala penuh jauh lebih luas dari yang banyak organisasi perkirakan. “Banyak proyek AI gagal mencapai nilai bisnis yang diharapkan karena perusahaan sering kali mengestimasi selisih antara eksperimen dan produksi terlalu rendah,” katanya. Walaupun ada minat yang kuat terhadap GenAI, biaya infrastruktur yang tinggi, latency yang tinggi, dan kesulitan menjalankan model pada skala besar seringkali menjadi hambatan.

Sebagian besar perusahaan masih bergantung pada pusat data sentral dan cluster GPU besar. Namun, dengan pertumbuhan penggunaan, setup ini menjadi terlalu mahal, terutama di wilayah yang jauh dari pusat data utama. Latensi juga menjadi masalah besar ketika model harus menjalankan beberapa tahap inferensi jarak jauh. “AI hanya sekuat infrastruktur dan arsitektur yang menjalankannya,” kata Jenkins, menambahkan bahwa latensi sering meredam pengalaman pengguna dan nilai bisnis yang diharapkan. Dia juga menunjukkan bahwa setup multi-cloud, aturan data kompleks, dan kebutuhan kompatibilitas yang berkembang seringkali menjadi hambatan yang melambatkan perpindahan dari proyek pilot ke produksi.

Mengapa Inferensi Sekarang Membutuhkan Perhatian Lebih dari Training

Di APAC, adopsi AI sedang berpindah dari piloting ke implementasi nyata dalam aplikasi dan layanan. Jenkins menunjukkan bahwa saat ini, inferensi harian – bukan siklus pelatihan yang jarang – yang mengkonsumsi sebagian besar daya komputasi. Dengan banyak organisasi meluncurkan model bahasa, visi, dan multimodal di berbagai pasar, permintaan inferensi yang cepat dan andal meningkat lebih cepat dari yang diharapkan. Itulah mengapa inferensi sekarang menjadi batasan utama di wilayah ini. Model harus beroperasi dalam berbagai bahasa, regulasi, dan lingkungan data, seringkali dalam real-time. Hal ini memberikan tekanan besar pada sistem pusat yang tidak pernah dirancang untuk responsivitas tingkat ini.

Efek Positif dari Infrastruktur Edge

Menempatkan inferensi lebih dekat dengan pengguna, perangkat, atau agen dapat merubah persamaan biaya. Melakukan ini mengurangi jarak yang harus ditempuh oleh data dan memungkinkan model merespons lebih cepat. Ini juga menghindari biaya dari pengiriman volume data besar antara pusat data utama.

Sistem fisik AI – robot, mesin otomatis, atau alat kota pintar – bergantung pada keputusan yang diambil dalam milidetik. Saat inferensi berlangsung jauh, sistem ini tidak berfungsi seperti yang diharapkan.

Dampak Signifikan pada Bisnis dan Teknologi

Perubahan ini tidak hanya menghemat biaya, tetapi juga mempengaruhi cara perusahaan beroperasi. Dengan menggeser inferensi ke perbatasan, perusahaan dapat mengurangi biaya operasional dan mempercepat respons. Misalnya, perusahaan di India dan Vietnam melihat penurunan signifikan dalam biaya menjalankan model generasi gambar ketika beban kerja dipindahkan ke perbatasan, bukan pusat data sentral. Penggunaan GPU yang lebih baik dan biaya keluar yang lebih rendah berperan besar dalam penurunan biaya tersebut.

Kesimpulan

Perubahan infrastruktur ini tidak hanya menghemat biaya, tetapi juga mempengaruhi cara perusahaan beroperasi. Dengan menggeser inferensi ke perbatasan, perusahaan dapat mengurangi biaya operasional dan mempercepat respons. Meskipun masih ada tantangan, perubahan ini menunjukkan langkah penting menuju kedaulatan teknologi yang lebih besar.

Dalam era digital ini, keberhasilan perusahaan tidak hanya tergantung pada kemampuan mereka untuk memanfaatkan AI, tetapi juga bagaimana mereka mengelola dan mengoptimalkan infrastruktur yang mendukungnya. Dengan memperhatikan perubahan ini, perusahaan dapat memastikan bahwa mereka tidak hanya mengikuti tren, tetapi juga memainkan peran penting dalam membentuk masa depan teknologi.